國家市場監管總局等部門聯合發布了《藥品網絡銷售監督管理辦法》,標志著我國藥品網絡銷售監管進入全新階段,尤其對備受關注的網售處方藥提出了明確要求。與此利用信息網絡經營動漫產品的相關法規也在持續完善。這兩大領域看似獨立,實則共同反映了在數字經濟蓬勃發展背景下,國家對網絡市場秩序、消費者權益保護以及內容安全監管的日益重視。

一、藥品網售新規:網售處方藥迎來規范化時代

新規的核心在于為網售處方藥“立規矩”,確保用藥安全。其主要要求包括:

- 嚴格處方審核與管理:藥品網絡零售企業必須確保處方來源真實、可靠,實行“先方后藥”,嚴禁先售藥后補方。處方須經執業藥師審核調配,并建立處方審核記錄制度。

- 明確主體責任:落實平臺經營者管理責任,要求其對入駐商家資質進行審核,建立藥品質量安全管理、不良反應報告等制度,并對銷售行為進行監測。

- 強化信息展示與風險警示:處方藥銷售頁面需突出顯示“處方藥須憑處方購買”等警示信息,不得直接公開展示處方藥包裝、標簽等信息,須經消費者授權方可提供。

- 保障配送安全:藥品配送需符合GSP(藥品經營質量管理規范)要求,確保運輸過程不影響藥品質量,特別是對溫度敏感的藥品需有特殊保障。

- 加強監管與處罰:明確了各級藥監部門的監管職責,對違法違規行為設定了嚴厲的處罰措施,包括罰款、停業整頓直至吊銷許可證。

新規的實施,旨在杜絕處方藥濫用風險,保護患者隱私與用藥安全,推動醫藥電商行業從“野蠻生長”轉向“規范發展”。對行業而言,短期內合規成本可能上升,但長遠看有利于淘汰不合規企業,為守法經營者創造公平競爭環境,并增強消費者線上購藥信心。

二、利用信息網絡經營動漫產品:內容合規與版權保護并重

利用信息網絡經營動漫產品(包括發行、傳播、衍生品銷售等)近年來增長迅猛,其監管重點在于內容安全和知識產權保護。相關法規要求:

- 內容審核前置:經營主體需對傳播的動漫產品內容進行嚴格自查,確保符合國家法律法規和社會主義核心價值觀,不得含有危害國家安全、暴力、色情等禁止內容。網絡平臺需落實主體責任,建立健全內容審核機制。

- 版權授權清晰:經營動漫產品必須具備完整的版權鏈條或合法授權,嚴厲打擊盜版、非法傳播行為。鼓勵原創,保護創作者權益。

- 未成年人保護:對可能影響未成年人身心健康的動漫產品,應設置適齡提示、觀看時長限制等保護措施。

- 規范營銷行為:廣告宣傳需真實合法,不得虛假夸大,針對未成年人的營銷活動需特別審慎。

這一領域的監管,旨在促進動漫產業健康有序發展,鼓勵優質原創內容產出,同時維護清朗的網絡空間。

三、新規時代的行業啟示與應對策略

無論是藥品網售還是動漫產品網絡經營,新規都傳遞出明確信號:數字經濟必須在法治軌道上運行,安全、合規是生命線。

對于相關企業而言,應采取以下應對策略:

- 主動擁抱合規:深入學習新規要求,全面自查整改業務流程,特別是在處方審核(醫藥)、內容審核(動漫)等關鍵環節建立標準化、可追溯的內部控制體系。

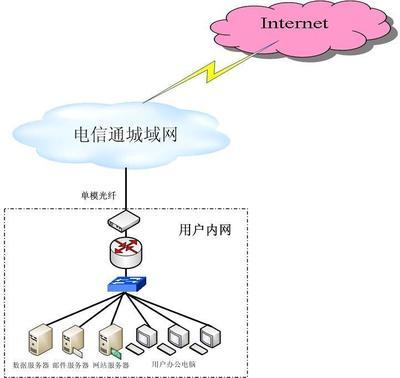

- 強化技術賦能:利用大數據、人工智能等技術提升處方真實性核驗、藥品追溯、內容智能過濾、版權識別等能力,提高合規效率。

- 構建協同生態:醫藥電商平臺需加強與醫療機構、醫保系統的銜接;動漫平臺需與版權方、創作者建立更緊密的授權與合作關系。

- 提升專業服務:醫藥電商應加強藥師團隊建設,提供專業用藥咨詢;動漫平臺可優化內容推薦算法,豐富正向優質內容供給。

****

《藥品網售新規》的出臺與動漫產品網絡經營的規范,是國家完善數字經濟治理體系的重要舉措。它們分別從實體商品安全與數字內容安全兩個維度,劃定了市場行為的紅線與底線。對于行業參與者,這既是挑戰,更是走向高質量發展、贏得長期信任的契機。唯有將合規意識內化于心、外化于行,才能在日新月異的數字市場中行穩致遠。